pt

pt  English

English  Español

Español  中國人

中國人  Tiếng Việt

Tiếng Việt  Deutsch

Deutsch  Українська

Українська  Français

Français  भारतीय

भारतीय  Türkçe

Türkçe  한국인

한국인  Italiano

Italiano  Gaeilge

Gaeilge  اردو

اردو  Indonesia

Indonesia  Polski

Polski A raspagem de avaliações da Amazon com Python é útil ao realizar análises de concorrentes, verificar avaliações e fazer pesquisas de mercado. Isso demonstra como raspar análises de produtos na Amazon de forma eficiente com as bibliotecas Python, BeautifulSoup e Requests.

Antes de mergulhar no processo de raspagem, certifique-se de ter as bibliotecas Python necessárias instaladas:

pip install requests

pip install beautifulsoup4Vamos nos concentrar na extração de análises de produtos da página da Amazon e examinar cada etapa do processo de raspagem passo a passo.

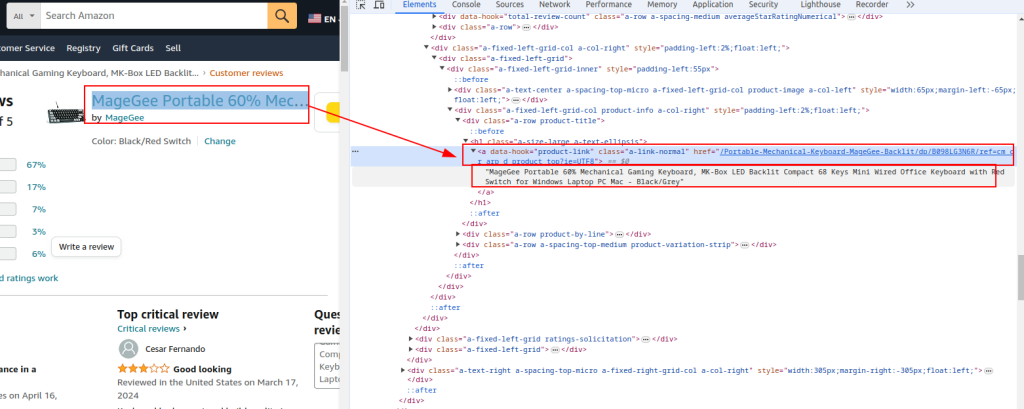

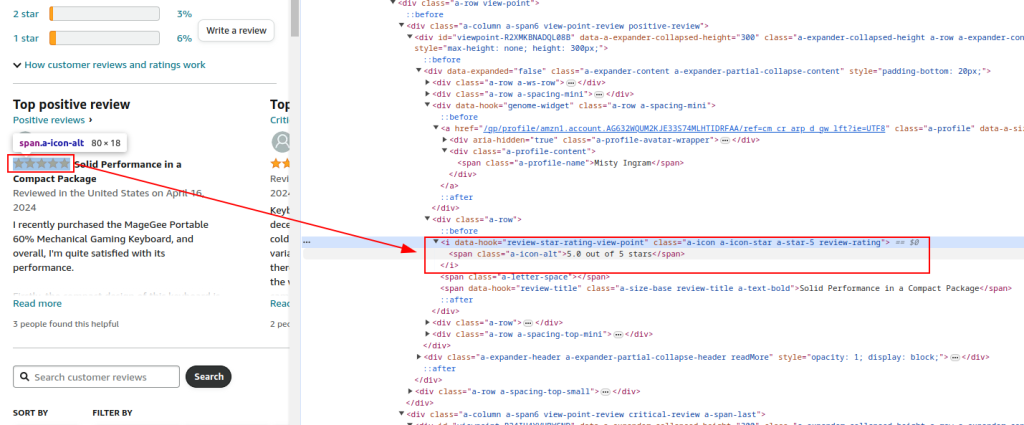

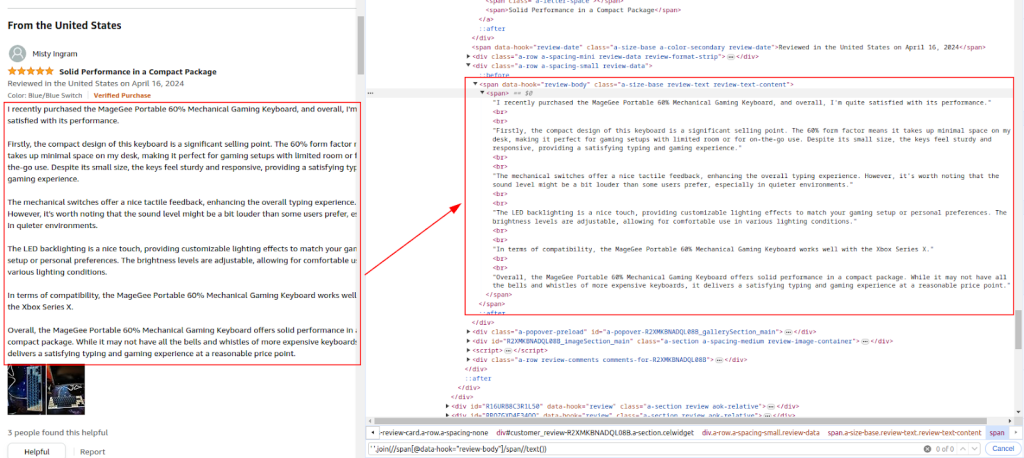

Inspecione a estrutura HTML da página de avaliações de produtos da Amazon para identificar os elementos que queremos extrair: nomes de avaliadores, classificações e comentários.

Título do produto e URL:

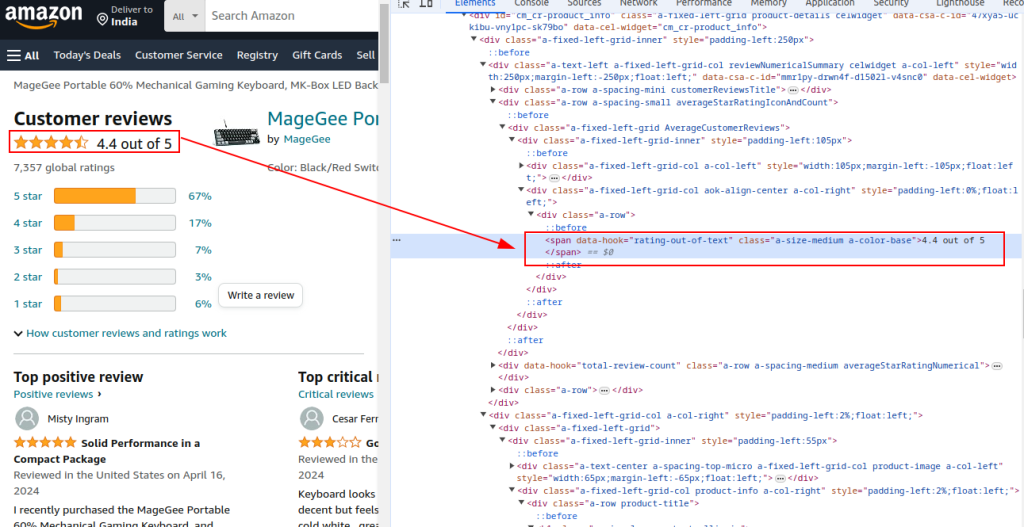

Classificação total:

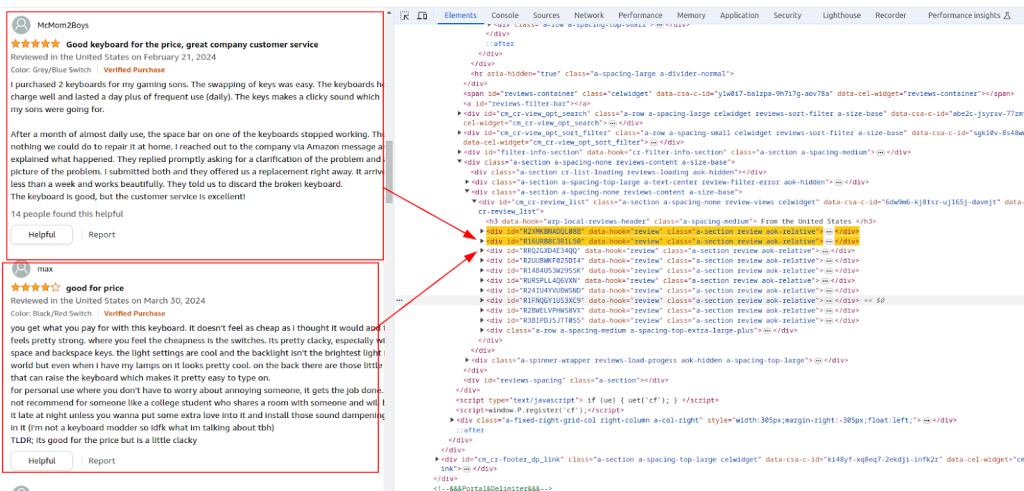

Secção de revisão:

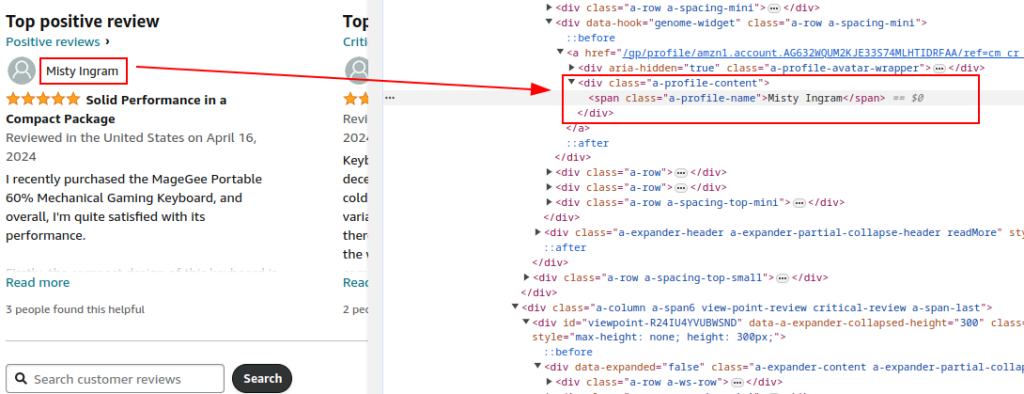

Nome do autor:

Classificação:

Comentário:

Use a biblioteca Requests para enviar solicitações HTTP GET para a página de análises de produtos da Amazon. Configure os cabeçalhos para imitar o comportamento legítimo do navegador e evitar a deteção. Proxies e cabeçalhos de solicitação completos são essenciais para evitar ser bloqueado pela Amazon.

O uso de proxies ajuda a girar os endereços IP para evitar proibições de IP e limites de taxa da Amazon. É crucial para a raspagem em grande escala para manter o anonimato e evitar a deteção. Aqui, os detalhes do proxy são fornecidos pelo serviço de proxy.

A inclusão de vários cabeçalhos como Accept-Encoding, Accept-Language, Referer, Connection e Upgrade-Insecure-Requests imita uma solicitação legítima do navegador, reduzindo a chance de ser sinalizado como um bot.

import requests

url = "https://www.amazon.com/Portable-Mechanical-Keyboard-MageGee-Backlit/product-reviews/B098LG3N6R/ref=cm_cr_dp_d_show_all_btm?ie=UTF8&reviewerType=all_reviews"

# Exemplo de um proxy fornecido pelo serviço de proxy

proxy = {

'http': 'http://your_proxy_ip:your_proxy_port',

'https': 'https://your_proxy_ip:your_proxy_port'

}

headers = {

'accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,image/avif,image/webp,image/apng,*/*;q=0.8,application/signed-exchange;v=b3;q=0.7',

'accept-language': 'en-US,en;q=0.9',

'cache-control': 'no-cache',

'dnt': '1',

'pragma': 'no-cache',

'sec-ch-ua': '"Not/A)Brand";v="99", "Google Chrome";v="91", "Chromium";v="91"',

'sec-ch-ua-mobile': '?0',

'sec-fetch-dest': 'document',

'sec-fetch-mode': 'navigate',

'sec-fetch-site': 'same-origin',

'sec-fetch-user': '?1',

'upgrade-insecure-requests': '1',

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

}

# Enviar um pedido HTTP GET para o URL com cabeçalhos e proxy

try:

response = requests.get(url, headers=headers, proxies=proxy, timeout=10)

response.raise_for_status() # Raise an exception for bad response status

except requests.exceptions.RequestException as e:

print(f"Error: {e}")

Analise o conteúdo HTML da resposta usando BeautifulSoup para extrair detalhes comuns do produto, como URL, título e classificação total.

from bs4 import BeautifulSoup

soup = BeautifulSoup(response.content, 'html.parser')

# Extrair detalhes de produtos comuns

product_url = soup.find('a', {'data-hook': 'product-link'}).get('href', '')

product_title = soup.find('a', {'data-hook': 'product-link'}).get_text(strip=True)

total_rating = soup.find('span', {'data-hook': 'rating-out-of-text'}).get_text(strip=True)

Continue analisando o conteúdo HTML para extrair nomes de avaliadores, classificações e comentários com base nas expressões XPath identificadas.

reviews = []

review_elements = soup.find_all('div', {'data-hook': 'review'})

for review in review_elements:

author_name = review.find('span', class_='a-profile-name').get_text(strip=True)

rating_given = review.find('i', class_='review-rating').get_text(strip=True)

comment = review.find('span', class_='review-text').get_text(strip=True)

reviews.append({

'Product URL': product_url,

'Product Title': product_title,

'Total Rating': total_rating,

'Author': author_name,

'Rating': rating_given,

'Comment': comment,

})

Utilize o módulo CSV integrado do Python para guardar os dados extraídos num ficheiro CSV para análise posterior.

import csv

# Definir o caminho do ficheiro CSV

csv_file = 'amazon_reviews.csv'

# Definir nomes de campos CSV

fieldnames = ['Product URL', 'Product Title', 'Total Rating', 'Author', 'Rating', 'Comment']

# Escrever dados num ficheiro CSV

with open(csv_file, mode='w', newline='', encoding='utf-8') as file:

writer = csv.DictWriter(file, fieldnames=fieldnames)

writer.writeheader()

for review in reviews:

writer.writerow(review)

print(f"Data saved to {csv_file}")

Aqui está o código completo para raspar os dados de revisão da Amazon e salvá-los em um arquivo CSV:

import requests

from bs4 import BeautifulSoup

import csv

import urllib3

urllib3.disable_warnings()

# URL da página de análises de produtos da Amazon

url = "https://www.amazon.com/Portable-Mechanical-Keyboard-MageGee-Backlit/product-reviews/B098LG3N6R/ref=cm_cr_dp_d_show_all_btm?ie=UTF8&reviewerType=all_reviews"

# Proxy fornecido pelo serviço de proxy com autorização de IP

path_proxy = 'your_proxy_ip:your_proxy_port'

proxy = {

'http': f'http://{path_proxy}',

'https': f'https://{path_proxy}'

}

# Cabeçalhos para o pedido HTTP

headers = {

'accept': 'text/html,application/xhtml+xml,application/xml;q=0.9,image/avif,image/webp,image/apng,*/*;q=0.8,application/signed-exchange;v=b3;q=0.7',

'accept-language': 'en-US,en;q=0.9',

'cache-control': 'no-cache',

'dnt': '1',

'pragma': 'no-cache',

'sec-ch-ua': '"Not/A)Brand";v="99", "Google Chrome";v="91", "Chromium";v="91"',

'sec-ch-ua-mobile': '?0',

'sec-fetch-dest': 'document',

'sec-fetch-mode': 'navigate',

'sec-fetch-site': 'same-origin',

'sec-fetch-user': '?1',

'upgrade-insecure-requests': '1',

'user-agent': 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/91.0.4472.124 Safari/537.36',

}

# Enviar um pedido HTTP GET para o URL com cabeçalhos e tratar as excepções

try:

response = requests.get(url, headers=headers, timeout=10, proxies=proxy, verify=False)

response.raise_for_status() # Raise an exception for bad response status

except requests.exceptions.RequestException as e:

print(f"Error: {e}")

# Analisar o conteúdo HTML usando BeautifulSoup

soup = BeautifulSoup(response.content, 'html.parser')

# Extrair detalhes de produtos comuns

product_url = soup.find('a', {'data-hook': 'product-link'}).get('href', '') # Extract product URL

product_title = soup.find('a', {'data-hook': 'product-link'}).get_text(strip=True) # Extract product title

total_rating = soup.find('span', {'data-hook': 'rating-out-of-text'}).get_text(strip=True) # Extract total rating

# Extrair revisões individuais

reviews = []

review_elements = soup.find_all('div', {'data-hook': 'review'})

for review in review_elements:

author_name = review.find('span', class_='a-profile-name').get_text(strip=True) # Extract author name

rating_given = review.find('i', class_='review-rating').get_text(strip=True) # Extract rating given

comment = review.find('span', class_='review-text').get_text(strip=True) # Extract review comment

# Armazenar cada revisão num dicionário

reviews.append({

'Product URL': product_url,

'Product Title': product_title,

'Total Rating': total_rating,

'Author': author_name,

'Rating': rating_given,

'Comment': comment,

})

# Definir o caminho do ficheiro CSV

csv_file = 'amazon_reviews.csv'

# Definir nomes de campos CSV

fieldnames = ['Product URL', 'Product Title', 'Total Rating', 'Author', 'Rating', 'Comment']

# Escrever dados num ficheiro CSV

with open(csv_file, mode='w', newline='', encoding='utf-8') as file:

writer = csv.DictWriter(file, fieldnames=fieldnames)

writer.writeheader()

for review in reviews:

writer.writerow(review)

# Imprimir mensagem de confirmação

print(f"Data saved to {csv_file}")

Em conclusão, é crucial sublinhar que a seleção de servidores proxy fiáveis é um passo fundamental na escrita de scripts para a recolha de dados da Web. Isto garante um desvio eficaz dos bloqueios e proteção contra filtros anti-bot. As opções mais adequadas para o scraping são os servidores proxy residenciais, que oferecem um elevado fator de confiança e endereços IP dinâmicos, juntamente com proxies ISP estáticos que proporcionam alta velocidade e estabilidade operacional.

Comentários: 0